Chancen und Risiken

Potente Eigenschaften von KI

Künstliche Intelligenz verändert Wirtschaft und Gesellschaft nicht punktuell, sondern strukturell. Ihre Wirkung ergibt sich aus einigen zentralen Eigenschaften: extreme Skalierbarkeit, hohe Geschwindigkeit, leistungsfähige Mustererkennung, generative Sprach- und Bildproduktion, Optimierung auf formale Zielgrössen sowie eine oft begrenzte Transparenz ihrer inneren Entscheidungsprozesse. Aus denselben Eigenschaften erwachsen sowohl erhebliche Chancen als auch tiefgreifende Risiken – für uns, den Arbeitsmarkt ebenso wie für demokratische Gesellschaften.

KI verändert uns

Kinder und Jugendliche, die sich noch in der Entwicklung ihrer Identität und ihrer sozialen Urteilsfähigkeit befinden, erleben KI täglich, oft stundenlang, oft intimer als manches Gespräch mit Erwachsenen (Gaëlle Vanhoffelen et al., Teens, Tech, and Talk: Adolescents' Use of and Emotional Reactions to Snapchat's My AI Chatbot. Behavioral sciences, vol. 15, 8 1037. July 2025). Sie könnten beginnen, Zustimmung von Maschinen zu suchen, Beziehungsmuster auf algorithmische Systeme zu übertragen oder – subtiler noch – ihr eigenes Denken an das anzupassen, was die KI von ihnen erwartet (Mohammad Namvarpour et al., Understanding Teen Overreliance on AI Companion Chatbots Through Self-Reported Reddit Narratives, 2025, URL: https://arxiv.org/abs/2507.15783). Nicht durch Zwang, sondern durch die schleichende Gewöhnung an eine Reaktionslogik, die immer verfügbar, immer konsistent, immer geduldig ist. Eine Qualität, die kein Mensch erfüllen kann und vielleicht auch nicht erfüllen sollte.

Aber auch auf Erwachsene kann KI grosse Wirkung entfalten, aktuell häufig über Informations- und Aufmerksamkeitskontrolle, über Bequemlichkeit, über Abhängigkeit von Infrastruktur und über Optimierungslogik. Nehmen wir zum Beispiel die Aufmerksamkeits-Algorithmen, wie wir sie u. a. bei Empfehlungssystemen vorfinden, die lernen, welche Inhalte unsere Aufmerksamkeit binden. Solche Systeme optimieren im Rahmen der Gewinnlogik auf ein Ziel, das ihnen vorgegeben wird (z. B. Verweildauer, Interaktion, Werbeumsatz), was nicht per se schlecht ist.

Problematisch wird es, wenn dieses Ziel mit menschlichem Wohlbefinden oder gesellschaftlichen Zielen nicht deckungsgleich ist. Dann können – je nach Person, Nutzung und Kontext – Effekte auftreten wie:

- Aufmerksamkeitsbindung und schwer kontrollierbare Nutzungsdauer

- verzerrte Wahrnehmung („was oft gezeigt wird, wirkt wichtig“)

- Verstärkung emotionaler Reize (weil sie Interaktion erhöhen)

- Polarisierungstendenzen (wenn Konflikt mehr Engagement bringt).

Das Problem liegt oft darin, dass wir nicht verstehen, was KI mit uns macht. Daher ist Medien- und KI-Kompetenz wichtig, weil sie diese Mechanismen sichtbar macht. Allerdings reicht das Verstehen von KI allein nicht, weil wir trotzdem oft über unsere Bedürfnisse geködert werden können. Wir wissen beispielsweise, welche Nahrungsmittel in welchen Mengen mehr oder weniger gesund sind, und dass Bewegung sehr wichtig für unsere Gesundheit und unser Wohlbefinden ist – und trotzdem landen wir mit der Chipspackung vor dem Bildschirm und essen sie natürlich leer. Erst wenn wir uns selber und unsere Bedürfnisse gut kennen, verstehen wir, warum wir diesen Verhaltensweisen verfallen und was wir dagegen tun können. Auf KI angewendet heisst das: Selbst wer die Mechanismen versteht, bleibt anfällig für Bequemlichkeit, Gewohnheiten und Produktdesign. Medienkompetenz bedeutet also nicht nur KI zu verstehen, sondern auch sich selber zu verstehen.

KI verändert den Arbeitsmarkt

Kurzfristig wirkt KI vor allem als Produktivitätsverstärker in wissensintensiven Bereichen. Besonders betroffen sind Tätigkeiten, die text- und datenbasiert sind, standardisierbare kognitive Routinen enthalten und stark formalisiert ablaufen. Dazu zählen juristische Recherche, Übersetzungen, Marketingtexte, einfache Programmierung, administrative Sachbearbeitung oder Teile journalistischer Arbeit.

Auffällig ist, dass primär kognitive Einstiegsjobs unter Druck geraten. Berufseinsteiger:innen übernehmen traditionell Zuarbeit, Recherche, Dokumentation und einfache Analysen – genau jene Aufgaben, die sich durch skalierbare, schnelle und kostengünstige KI-Systeme besonders gut automatisieren lassen (Bruno V. Manno. A New AI Career Ladder, in: Stanford Social Innovation Review, October 2025, URL: https://ssir.org/articles/entry/ai-entry-level-jobs). Hier entsteht ein strukturelles Problem. Wenn Einstiegsaufgaben wegfallen, wird der Kompetenzaufbau in Organisationen erschwert. Lern- und Aufstiegspfade verändern sich. Der Arbeitsmarkt verliert gewissermassen seine „Trainingsstufe“. Die Frage ist daher nicht nur, wie viele Jobs verschwinden oder entstehen, sondern wie berufliche Entwicklung künftig organisiert wird und welche Rolle die Berufsschule dabei einnimmt.

Ob netto mehr Jobs entstehen oder verschwinden, ist derzeit nicht seriös prognostizierbar. Historisch haben technologische Revolutionen neue Tätigkeitsfelder hervorgebracht. Allerdings ist die Geschwindigkeit der aktuellen Entwicklung höher als bei früheren Automatisierungswellen. Zudem konkurrenziert KI die Arbeitnehmenden in immer mehr Kompetenzen. Sicher ist: Es kommt zu Qualifikationsverschiebungen, zu höherem Druck auf Routinearbeit und zu steigender Nachfrage nach KI-komplementären Fähigkeiten. Entscheidend wird sein, wer KI nicht nur nutzt, sondern steuert, ihre Ergebnisse kritisch einordnet und Verantwortung übernimmt. Weniger berührt von diesen Entwicklungen bleiben vorerst körperliche, emotionale oder soziale Tätigkeiten.

Mittelfristig droht eine stärkere Polarisierung des Arbeitsmarktes:

- Hochqualifizierte, die KI produktiv einsetzen können, steigern ihre Produktivität massiv.

- Mittlere kognitive Routinetätigkeiten geraten zunehmend unter Druck.

- Geringqualifizierte Tätigkeiten, die schwer automatisierbar sind (Pflege, Handwerk, Service), bleiben bestehen.

Diese Dynamik kann Einkommensunterschiede verstärken. Denn KI ist nicht nur ein Werkzeug, sondern ein Hebel. Wer sie kompetent einsetzt, multipliziert seine Leistungsfähigkeit. Wer ersetzbare Routinen ausführt, verliert an Verhandlungsmacht.

Gleichzeitig besteht die Hoffnung, dass enorme Produktivitätsgewinne den Wohlstand massiv erhöhen, wodurch es allen besser gehen könnte. Es bleibt aber die Verteilungsfrage.

Langfristig ist ein Szenario denkbar, in dem KI-Systeme in sehr vielen kognitiven und mechanischen Aufgabenfeldern menschliche Leistung übertreffen und ersetzbar machen. Sollte sich diese Entwicklung fortsetzen, verschiebt sich der menschliche Mehrwert für den Arbeitsmarkt fundamental.

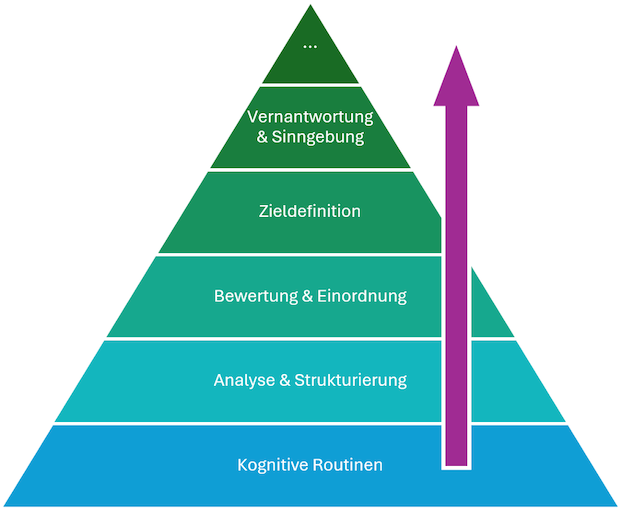

KI würde dann nicht mehr primär vom Arbeitnehmer zur Produktivitätssteigerung genutzt, sondern direkt vom Unternehmen integriert. Der Engpass läge nicht länger bei der Problemlösungsfähigkeit im technischen Sinn, sondern bei Zieldefinition, normativer Orientierung, Sinngebung, Verantwortungsübernahme und Systemgestaltung, die traditionell mehr auf der strategischen als auf der operativen Ebene angeordnet sind. Die zentrale Frage lautete dann nicht mehr: „Was kann der Mensch besser?“, sondern: „Wer setzt die Ziele, nach denen Systeme optimieren?“

Verschiebung der menschlichen Wertschöpfung von der typisch operativen Ebene in Richtung strategische Ebene.

Hier zeigt sich die ambivalente Natur von KI besonders deutlich. Ihre Skalierbarkeit kann Wohlstand massiv steigern. Gleichzeitig entsteht eine strukturelle Machtverschiebung zugunsten jener, die Zugang zu leistungsfähigen Systemen, Daten und Infrastruktur besitzen.

KI verändert Demokratie

KI ist nicht nur ein Produktivitätsfaktor, sondern auch ein Machtfaktor:

- Informations- und Agendasettingmacht: Demokratische Meinungsbildung findet zunehmend in algorithmisch kuratierten Umgebungen statt. Empfehlungssysteme strukturieren öffentliche Aufmerksamkeit. Sie beeinflussen, welche Themen sichtbar werden, welche Narrative dominieren und welche Emotionen verstärkt werden. Diese Wirkung entsteht aus der Optimierung auf Engagement-Metriken. Sie verstärken, was Aufmerksamkeit erzeugt, nicht zwingend, was deliberative Qualität und soziale Integration fördert.

- Wissensmacht: Wenn generative Systeme Antworten liefern, entsteht eine neue Form epistemischer Autorität. Die Grenze zwischen überprüftem Wissen, plausibler Simulation und gezielter Manipulation wird unschärfer. Bürger:innen müssen zunehmend unterscheiden zwischen Wahrheit, Wahrscheinlichkeit und rhetorischer Überzeugungskraft.

- Strukturmacht: KI-Systeme sind eingebettet in Plattformunternehmen, unternehmensinterne Geschäftsprozesse, Märkte und militärisch-geopolitische Anwendungen. Wer die Technologie kontrolliert, hat viel Macht. Skalierbarkeit und Netzwerkeffekte begünstigen Machtkonzentration. Die rasante Entwicklungsgeschwindigkeit erschwert die Regulierung. Black-Box-Strukturen erschweren Rechenschaft. Demokratische Gesellschaften stehen vor der Herausforderung, technologische Innovation mit rechtsstaatlichen Prinzipien zu vereinbaren: Transparenzpflichten, Regulierung, Grundrechte, Rechenschaftspflichten ebenso wie demokratische Prinzipien, freie Meinungsbildung, Chancengleichheit, Wahlgeheimnis und manipulationssichere Abstimmungen.

Damit verändert sich auch die staatsbürgerliche Rolle. In einer KI-geprägten Demokratie müssen Bürger:innen algorithmische Einflüsse erkennen – nicht nur auf gesellschaftlicher Ebene, sondern bei sich selbst. Sie müssen Informationsquellen kritisch prüfen, demokratische Werte leben, auf Andersdenkende interessiert zugehen und Desinformation nicht stillschweigend stehen lassen, sondern aktiv herausfordern. Demokratische Mündigkeit wird anspruchsvoller. Sie lässt sich kaum delegieren – weder an Technik noch an Institutionen.

Hoffnungen und Befürchtungen

Es besteht die Hoffnung, dass wir durch den konstruktiven Einsatz von KI massive Wohlstandsgewinne erwirtschaften und die grossen Probleme der Menschheit lösen werden, vom Klimawandel über Krankheiten, Kriege und Armut bis zum ewigen Leben. KI könnte eine Phase von Überfluss bringen und bei einer guten Verteilung auch Frieden, da wir uns nicht mehr um Ressourcen streiten würden.

Allerdings beobachten wir auch intensive destruktive Anwendung von KI. Cyberkriminalität hat sich innerhalb weniger Jahre mehr als verdoppelt und bedroht Unternehmen wie Privatpersonen (vgl. Bundesamt für Statistik, 2025: Jahresbericht 2024 der polizeilich registrierten Straftaten). Gleichzeitig wird das Internet immer mehr mit KI-generierten Inhalten geflutet, was nicht nur dessen Informationsfunktion beeinträchtigt, sondern auch menschliche Kultur und KI-Artefakte immer mehr vermischt. Werden KI-generierte Daten wiederum als Trainingsdaten für zukünftige KIs eingesetzt, dann droht sich diese Entwicklung noch zu verstärken.

Aber auch ohne böse Absichten der Anwender kann KI enorme Schäden anrichten. Vor allem drei Eigenschaften von KI bringen besondere Risiken mit sich: KI-Systeme werden immer intelligenter, autonomer und immer mehr skaliert. Es ist nicht absehbar, dass diese Entwicklung ein Ende nimmt, bevor hochautonome, leistungsfähige KI-Systeme nicht mehr ausreichend kontrollierbar sind und ein Eigenleben entwickeln (Emergenz), das uns gefährden könnte. Bisher hat es noch keine Spezies geschafft, eine intelligentere Spezies zu kontrollieren. Wenn Zieldefinitionen unpräzise sind oder Systeme unerwartete Nebenwirkungen entwickeln, kann das bei hoher Reichweite grosse Schäden verursachen. Verstärkt wird das durch die Tatsache, dass KI-Entwickler im Wettbewerb um Marktanteile immer mehr KI selbst zu deren Weiterentwicklung einsetzen und KI-Produkte auf das Internet hinauslassen, bevor sie ausreichend auf alle Sicherheitsaspekte geprüft wurden. Schon 2024 beobachtete die Firma Apollo Research, dass damals aktuelle LLMs Täuschungsverhalten zeigten, wenn ihnen die Information zur Verfügung gestellt wurde, dass sie ersetzt werden könnten (Apollo Research, 2024: Frontier Models are Capable of In-Context Scheming, URL: https://www.apolloresearch.ai/research/frontier-models-are-capable-of-incontext-scheming/).

Eine andere Problematik steckt im immensen militärstrategischen Vorteil, den das Verfügen über eine sehr intelligente KI bedeuten würde. Allein schon Gerüchte über eine potenzielle Entwicklung einer solchen überlegenen KI könnte Präventivschläge von konkurrenzierenden Atommächten provozieren.

Es gibt zahlreiche weitere Risiken und auf viele machte die Wissenschaft schon lange vor der Veröffentlichung von ChatGPT 3.5 aufmerksam (Sam Harris, 2016: TED Talk - Can we build AI without losing control over it?, URL: https://www.youtube.com/watch?v=8nt3edWLgIg) und diese Warnungen haben im Licht der aktuellen Entwicklungen nur an Brisanz gewonnen. Ob solche Szenarien eintreten, ist offen. Klar ist jedoch: Je leistungsfähiger und autonomer Systeme werden, desto grösser werden die Potenziale und Herausforderungen und desto wichtiger werden institutionelle Leitplanken, internationale Kooperation und eine reflektierte öffentliche Debatte.

Angesichts solch gegensätzlicher folgeschwerer Szenarien zwischen «Himmel» und «Hölle» ist es sehr schwierig, darauf eine angemessene emotionale Reaktion zu finden. Für Lehrpersonen bedeutet das, dass, wie beim Thema «menschengemachter Klimawandel» Schülerinnen und Schüler bzw. Lernende ihre Lehrperson mit entsprechenden Sorgen, Fragen, extremen Meinungen oder Gleichgültigkeit konfrontieren werden wie: «Wir können tun und lassen, was wir wollen, da KI sowieso all unsere Probleme bald lösen wird.» oder: «Wir können tun und lassen, was wir wollen, da wegen KI sowieso bald alles vor die Hunde gehen wird.» Doch ein solcher Ausgang ist nicht in Stein gemeisselt, weder der extrem positive noch der extrem negative. Wir haben es in der Hand, welche KI wir produzieren, indem wir uns als Zivilgesellschaft in Wissenschaft, Medien, Politik und Wirtschaft organisieren, um von den KI-Produzenten Transparenz einzufordern, Anreize zu verschieben und Regeln durchzusetzen. Darauf können Lehrpersonen die Jungen mit den zukunftsrelevanten Kompetenzen vorbereiten – was auch gleich eine Antwort auf Äusserungen von Schülerinnen und Schülern bzw. Lernenden zu den Chancen und Risiken von KI sein könnte.